MCP, LLM et workflows avec n8n : construire une architecture IA réellement exploitable

Un LLM n’est pas un système

Un LLM génère du texte. Une entreprise exécute des processus.

Entre les deux, il manque une structure.

Un modèle probabiliste ne peut pas interagir directement avec des API critiques sans cadre formel. Les API traditionnelles exigent :

des schémas stricts

des types valides

des permissions contrôlées

une gestion d’erreur déterministe

Un LLM, lui, reste statistique. C’est précisément ce décalage qui rend les intégrations naïves fragiles.

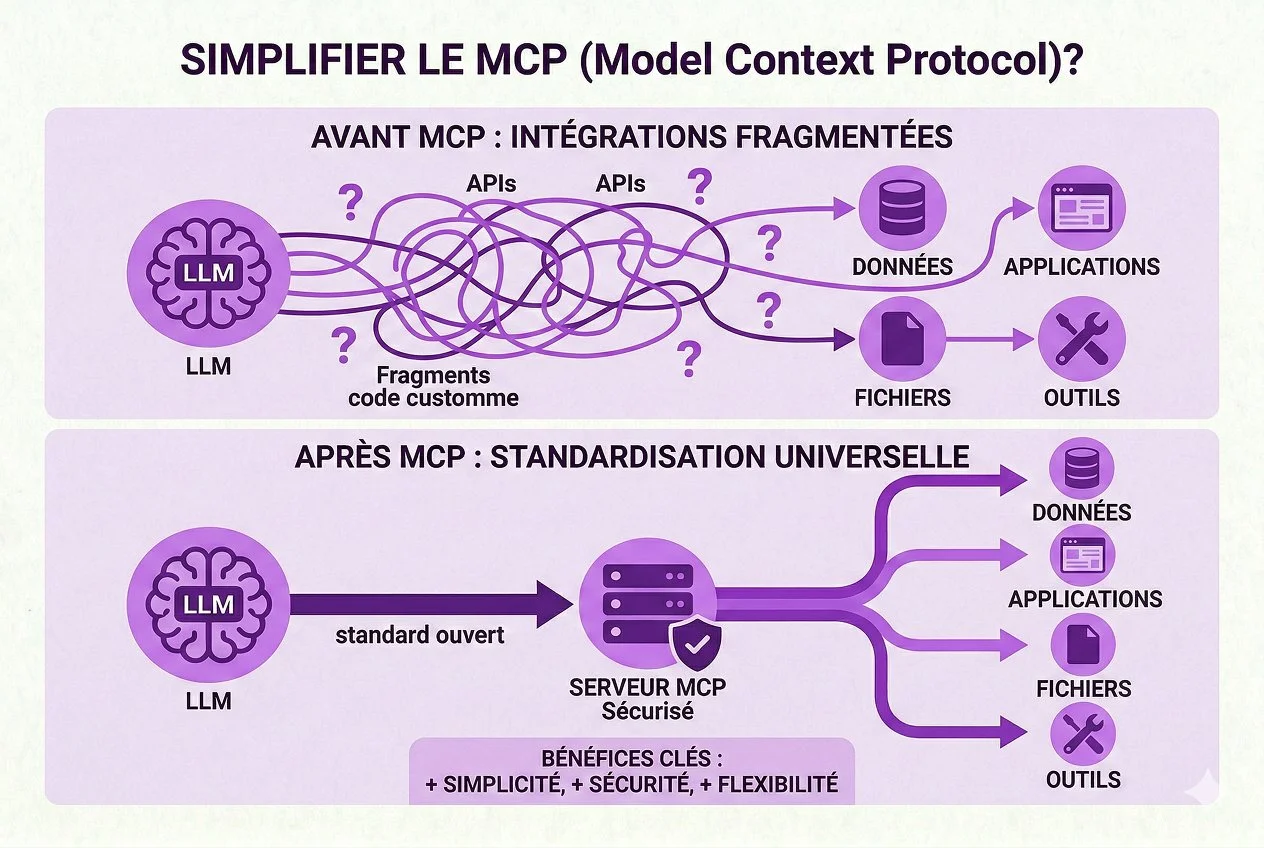

MCP vs API traditionnelles : le vrai sujet

Dans une architecture classique, une API REST expose des endpoints transactionnels. On envoie un payload conforme, on reçoit une réponse.

Ce modèle fonctionne parfaitement pour des systèmes déterministes, mais il présente plusieurs limites lorsqu’il est consommé par un LLM :

absence de sémantique métier explicite

aucune compréhension de l’intention

erreurs bloquantes au moindre écart de schéma

pas de gestion du contexte conversationnel

IBM le rappelle régulièrement dans sa documentation sur les architectures modernes : les API traditionnelles sont orientées transaction, alors que les systèmes intelligents exigent des interfaces enrichies, capables d’intégrer du contexte et des règles métier.

C’est exactement ce que vient résoudre le Model Context Protocol (MCP).

Ce que le Model Context Protocol change concrètement

Le MCP standardise la manière dont un modèle accède aux outils.

Il ne se contente pas de documenter un endpoint.

Il formalise :

le nom de l’outil

sa finalité métier

les paramètres attendus

leurs types

les contraintes

le périmètre d’action autorisé

On ne fournit plus seulement une API technique. On expose une capacité intelligible par le modèle.

La différence est majeure :

Une API dit :

“Voici un endpoint.”

Un MCP dit :

“Voici une action métier, ses règles et ses limites.”

Séparation fondamentale : décision et exécution

Dans une architecture robuste :

Le LLM décide de l’intention.

Le MCP encadre cette intention.

L’orchestrateur valide et exécute.

L’API applique.

Le modèle ne touche jamais directement à l’infrastructure.

Cette séparation réduit :

les hallucinations d’action

les appels malformés

les erreurs destructrices

les dérives imprévisibles

On passe d’un système fragile à un système contrôlé.

Pourquoi n8n est une brique stratégique

n8n ne remplace pas le MCP. Il le complète.

Là où le MCP définit le contrat entre le modèle et les outils, n8n gère :

les déclencheurs

la logique conditionnelle

la gestion d’erreurs

la persistance de données

le monitoring

l’enchaînement multi-étapes

Dans une architecture moderne :

MCP → expose les capacités

LLM → choisit l’action

n8n → orchestre

API → exécutent

C’est cette articulation qui permet le passage en production.

Cas concret : RAG connecté à un PIM

Prenons un e-commerce structuré :

Le PIM centralise la donnée produit.

Le RAG récupère l’information pertinente.

Le MCP expose les actions possibles (lecture, mise à jour, enrichissement).

Le LLM choisit l’opération adéquate.

n8n orchestre la séquence complète.

Le résultat se met à jour dans le PIM

La boucle est bouclée.

Le modèle ne modifie jamais directement la base. Il agit dans un cadre contractuel.

Résultat :

cohérence des données

génération contextualisée

synchronisation automatique

architecture scalable

La valeur ne vient pas du modèle seul. Elle vient de la structuration autour du modèle.

Ce qui échoue sans protocole

Les architectures fragiles présentent toujours les mêmes symptômes :

appels API générés directement par le modèle

logique métier noyée dans un prompt

absence de validation intermédiaire

permissions non isolées

À petite échelle, cela fonctionne. À grande échelle, cela devient instable. Le MCP est précisément conçu pour combler cet écart entre expérimentation et industrialisation.

Vers une IA réellement exploitable

Une architecture mature repose sur cinq couches distinctes :

Donnée structurée (PIM, CRM, base interne)

Couche d’exposition standardisée (MCP)

Modèle décisionnel (LLM)

Orchestration (n8n)

Exécution contrôlée (API)

Chacune a un rôle clair. Aucune ne doit absorber le rôle des autres.

Ce découplage est la clé de la stabilité.

MES ÉCLAIRCISSMENTS

Un LLM seul reste un moteur génératif. Une API seule reste mono directionnel.

Le MCP introduit la sémantique métier. n8n apporte l’orchestration.

C’est l’articulation de ces couches qui transforme une expérimentation IA en système exploitable. L’avantage compétitif ne réside pas dans le modèle choisi. Il réside dans la qualité de l’architecture qui l’encadre.