Reverse Engineering des LLM : comprendre comment une IA raisonne pour mieux la piloter

Le reverse engineering n’est pas du hacking

Le terme peut sembler agressif. Il ne s’agit pas de contourner un système ou d’exploiter une faille.

Le reverse engineering appliqué aux LLM consiste à :

Observer les outputs d’un modèle pour reconstruire la logique interne qui a produit ces résultats.

Autrement dit :

analyser la structure des réponses

identifier les patterns de raisonnement

comprendre les biais

détecter les dépendances implicites

remonter à la logique du prompt

C’est une discipline d’analyse. Et elle devient indispensable.

Pourquoi c’est devenu stratégique

Les LLM sont probabilistes. Ils ne “pensent” pas. Ils prédisent la suite la plus plausible.

Or, dans un contexte professionnel (SEO, RAG, agents, automatisation), ce n’est pas la créativité qui compte. C’est la fiabilité.

Le reverse engineering permet de :

réduire les hallucinations

stabiliser les outputs

comprendre les dérives

améliorer la reproductibilité

concevoir des agents robustes

Sans cette discipline, on prompt “au hasard”.

Le fonctionnement implicite d’un LLM

Un LLM réagit à :

Le contexte complet de la conversation

La structure du prompt

La hiérarchie implicite des instructions

Les exemples fournis

Le format attendu

La distribution statistique apprise lors de l’entraînement

Le reverse engineering consiste à tester systématiquement ces variables.

Méthodologie de reverse engineering

Voici une approche structurée.

Étape 1 : Isoler une tâche

Exemple : “Générer une description produit optimisée SEO.”

On observe :

la longueur

la structure

le ton

la répétition de mots-clés

la cohérence

Étape 2 : Modifier un seul paramètre

Ajouter une contrainte de format JSON

Supprimer une phrase du prompt

Inverser l’ordre des instructions

Ajouter un exemple

Puis comparer les outputs.

Étape 3 : Identifier les invariants

Quels éléments restent stables ?

Structure en paragraphes ?

Introduction systématique ?

Sur-optimisation ?

On commence à comprendre les biais internes.

Étape 4 : Reconstituer la logique dominante

On identifie :

Si le modèle privilégie la structure

Si le modèle privilégie la longueur

Si le modèle privilégie les mots-clés explicites

Si le modèle répond davantage à l’exemple qu’à l’instruction

C’est ici que l’architecture IA commence à se construire.

Exemple concret : JSON vs TOON

Si on demande :

“Génère une configuration d’agent.”

En format libre → réponse narrative.

En JSON strict → réponse structurée, plus courte.

En TOON → réponse plus lisible, souvent plus logique.

Reverse engineering :

Le modèle respecte fortement les formats normés.

Les contraintes syntaxiques réduisent la créativité.

Le format influence le niveau de précision.

Conclusion : Le format est un levier stratégique.

Reverse engineering et RAG

Dans une architecture RAG (Retrieval Augmented Generation), le modèle n’invente pas seulement. Il s’appuie sur une base documentaire. On en parlait déjà dans cet article sur le RAG et le STAG

Le reverse engineering consiste alors à analyser :

Comment le modèle cite la source

S’il reformule ou copie

S’il extrapole au-delà du document

S’il hiérarchise correctement l’information

C’est indispensable pour éviter les dérives.

Reverse engineering et SEO / GEO

Dans une logique SEO/GEO, l’enjeu est encore plus subtil.

Les moteurs génératifs sélectionnent des contenus selon :

leur structure

leur clarté

leur autorité

leur cohérence

En analysant les réponses générées par les LLM sur un sujet donné, on peut :

comprendre quelles formulations sont reprises

identifier les structures favorisées

adapter son contenu pour être mieux interprété

Le reverse engineering devient alors un outil stratégique de visibilité.

Les biais révélés par le reverse engineering

Un LLM peut :

privilégier des réponses consensuelles

éviter les positions tranchées

amplifier les formulations statistiques

sur-utiliser certaines structures narratives

En analysant ces tendances, on peut :

injecter plus de précision

contraindre la forme

améliorer la différenciation

Reverse engineering des agents IA

Dans un système multi-agents :

un agent planifie

un agent recherche

un agent génère

un agent valide

Le reverse engineering permet de :

comprendre les erreurs de coordination

identifier les pertes de contexte

ajuster les rôles

améliorer la transmission d’informations

On passe alors d’un simple prompt à une véritable architecture cognitive distribuée.

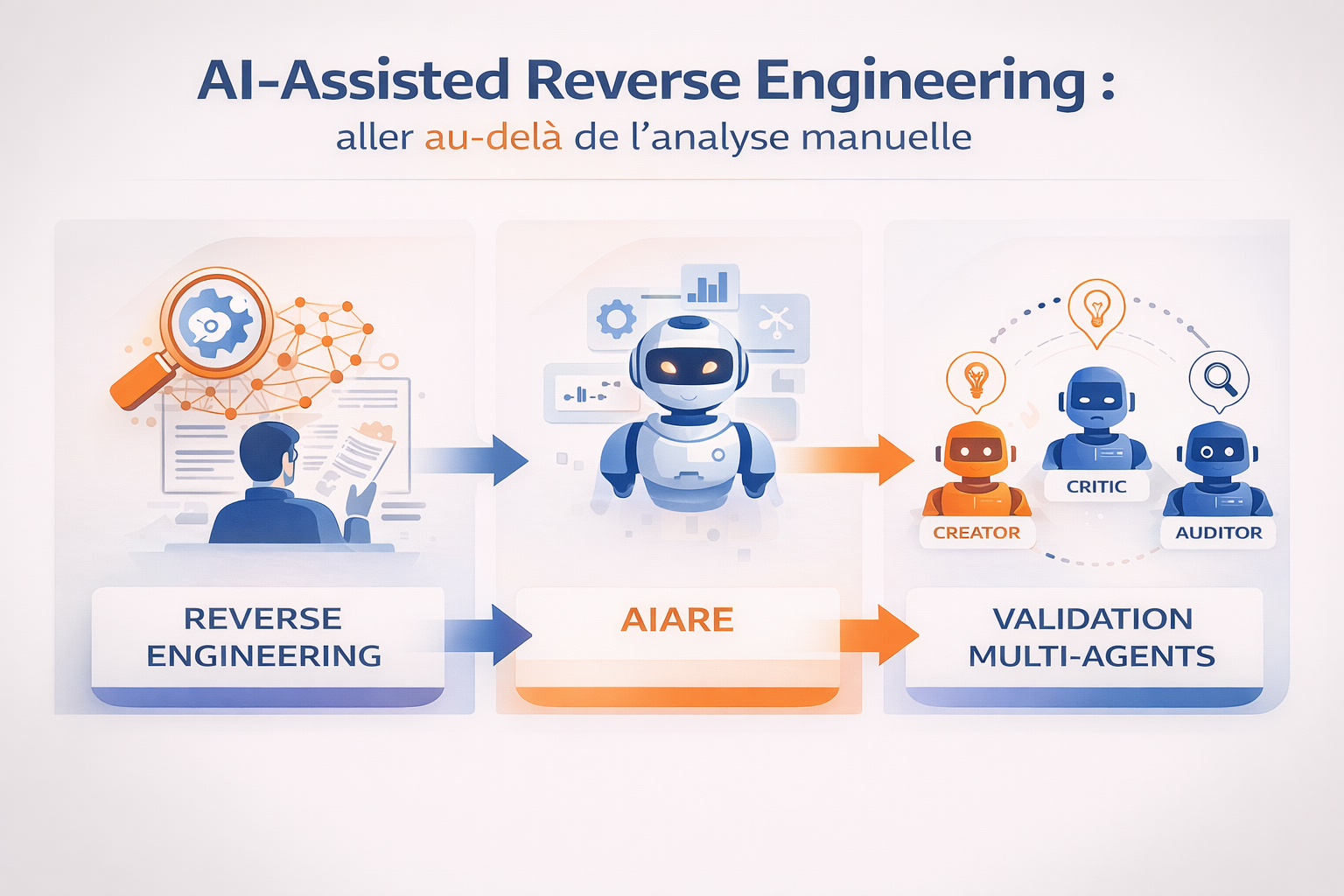

AIARE & Reverse Engineering

AI-Assisted Reverse Engineering (AIARE) : quand l’IA analyse l’IA

Le reverse engineering classique consiste à analyser manuellement les outputs d’un LLM pour en comprendre la logique implicite.

Mais une nouvelle couche émerge :

AI-Assisted Reverse Engineering (AIARE)

Utiliser un modèle d’IA pour analyser le comportement d’un autre modèle.

Autrement dit : on ne se contente plus d’observer les outputs. On demande à un système d’intelligence d’analyser la logique générative d’un autre.

Pourquoi AIARE change la donne

Les LLM sont devenus trop complexes pour être analysés uniquement à l’œil humain.

AIARE permet :

d’identifier automatiquement des patterns récurrents

de détecter des biais structurels

de mesurer la cohérence des réponses

de comparer plusieurs modèles entre eux

de tester des variations de prompts à grande échelle

On passe d’une analyse artisanale à une analyse industrielle.

Exemple concret d’AIARE

Imaginons un cas SEO.

Objectif : comprendre comment différents LLM répondent à la question : “Comment optimiser une fiche produit pour le SEO ?”

Processus AIARE :

Générer 50 réponses via différents modèles

Utiliser un second modèle pour :

analyser la structure

compter la densité sémantique

détecter les répétitions

mesurer la présence de mots-clés

identifier les angles récurrents

3. Classer les outputs selon cohérence / précision / originalité

Résultat : on obtient une cartographie comportementale des modèles. C’est du reverse engineering assisté par IA.

AIARE et RAG

Dans un environnement RAG, AIARE devient encore plus stratégique.

On peut :

analyser comment le modèle exploite les documents récupérés

mesurer le taux de fidélité à la source

détecter les extrapolations

identifier les hallucinations contextuelles

Un second agent peut auditer le premier. On entre alors dans une logique d’architecture multi-couches :

Agent 1 : génération

Agent 2 : analyse

Agent 3 : validation

L’IA devient auto-critique.

AIARE et agents multi-rôles

Dans des architectures avancées, on peut créer :

un agent “Creator”

un agent “Critic”

un agent “Auditor”

un agent “Optimizer”

Chaque agent analyse les autres.

Cela permet :

d’améliorer la stabilité

de réduire les dérives

d’augmenter la reproductibilité

d’automatiser la qualité

Ce n’est plus du prompt engineering. C’est de l’ingénierie systémique.

AIARE appliqué au SEO et au GEO

Dans un contexte GEO (Generative Engine Optimization), AIARE devient une arme stratégique.

On peut :

analyser les réponses générées par différents moteurs IA

identifier les structures les plus reprises

détecter les formulations favorisées

optimiser son contenu pour correspondre aux schémas dominants

Cela permet de comprendre :

pourquoi certains contenus sont cités

pourquoi d’autres disparaissent

comment structurer un article pour être mieux interprété

On ne subit plus l’algorithme. On analyse son comportement.

Les limites de l’AIARE

Il faut rester lucide. Un LLM ne comprend pas réellement le fonctionnement interne d’un autre modèle. Il analyse uniquement des outputs.

AIARE est puissant, mais il reste probabiliste.

Il permet :

d’inférer des tendances

pas de décoder les poids internes

C’est une couche d’intelligence appliquée à l’observation.

Pourquoi AIARE va devenir un standard

À mesure que :

les agents se multiplient

les architectures deviennent hybrides

les entreprises industrialisent l’IA

La validation automatique deviendra essentielle.

AIARE permet :

d’industrialiser la qualité

de réduire les erreurs

d’automatiser les audits

d’améliorer les performances

Ceux qui maîtriseront cette couche auront une longueur d’avance.

Les limites du reverse engineering

Il faut rester lucide. Un LLM reste une boîte noire. On peut analyser ses outputs. On ne peut pas accéder à ses poids internes.

Le reverse engineering permet :

d’inférer des comportements

pas de comprendre la totalité de l’architecture interne

C’est une analyse probabiliste, pas une lecture du code source.

Pourquoi cette compétence va devenir clé

À mesure que les IA s’intègrent dans :

le SEO

la rédaction

le support

la génération de code

la data

La différence ne sera pas :

“Qui utilise un LLM ?”

Mais :

“Qui comprend comment il fonctionne réellement ?”

Le reverse engineering est la discipline qui sépare l’utilisateur de l’architecte.

Pour bien comprendre

Le reverse engineering est déjà une compétence stratégique.

L’AI-Assisted Reverse Engineering en est l’évolution naturelle.

Dans un monde où les LLM deviennent omniprésents, l’avantage ne viendra pas de ceux qui génèrent le plus vite, mais de ceux qui analysent le plus finement.

Et demain, les architectures IA performantes ne seront pas composées d’un seul modèle, mais d’un système d’intelligences capables de s’observer mutuellement.